Yapay zekâ araçları hızla yaygınlaşırken, bu sistemlerin yanlış ve manipüle edilmiş bilgileri kolayca yayabildiği ortaya çıkıyor. Basit bir blog yazısıyla sohbet botlarını yanıltmanın mümkün olduğunu gösteren örnekler, yapay zekâya duyulan güvenin yeniden tartışılmasına neden oluyor.

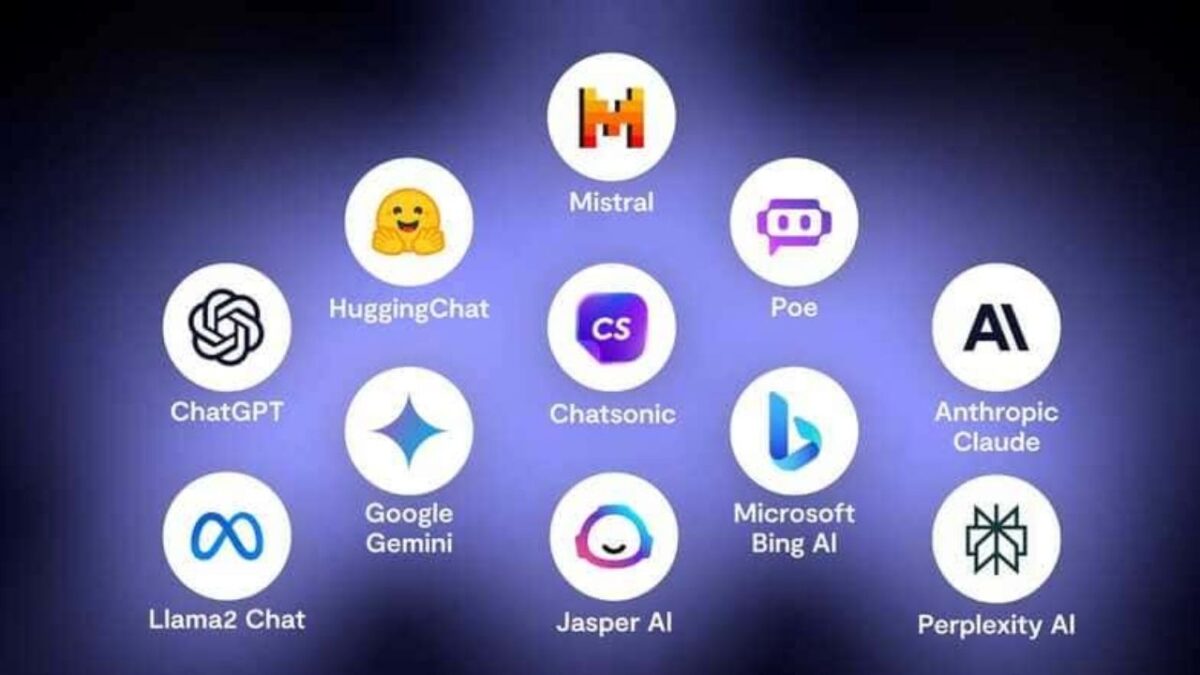

Birkaç yıl önceye kadar yapay zeka kullanımı çok geniş alana yayılmamıştı. Dolayısıyla bu araçları kullanan, hakkında konuşan ve işlerinde yardım alan kişiler daha çok profesyonellerdi. Yıllar içinde özellikle ChatGPT’nin de gelişiyle bir dönüşüm yaşandı ve yüz milyonlarca kişi en az bir yapay zeka platformunu kullanmaya başladı. En popüler araçlar Gemini, Claude ve ChatGPT gibi sohbet botları olsa da farklı işler için farklı modeller kullanılıyor. Örneğin, Claude genel anlamda en çok kullanılan araç. Araştırma ve arama kısımlarında en çok Perplexity ve iş için ChatGPT ve Azure AI gibi servisler tercih ediliyor.

Her ne kadar geliştirildiği günden bu yana çok hızlı bir şekilde yapaylığından kurtulsa da bilgisinin sınırları olması ve yanlış bilgiyi de kullanıcı karşısına çıkartması yapay zeka botlarını güvenilirliğini tartışmaya açıyor. Her ne kadar farklı örneklerle tecrübe etmiş olsak da yakın zaman önce bir gazeteci yapay zekanın basitçe kandırılabildiğini ve verdiği bilgilerin ne kadar kolay manipüle edilebileceğini gösterdi.

Yapay zekanın popülerleşmeye başladığı zamanlar olan 2023 yılında Medyaccope için Midjourney ve eksikliklerini derlemiştim. Geldiğimiz noktada artık insan ellerini güzel bir şekilde yapabiliyor ve birbirine karıştırmış yaratıklar haline getirmiyor, dişler ise olması gerektiği gibi görünüyor ancak tasarımsaldan açıdan bakıldığından daha büyük bir sorun var: Yapay zekanın yanlış bilgi ile manipüle edilebilir olması.

Konuya dair daha önce de epeyce söz söylendi ancak bunu bir örneklem üzerinden daha iyi anlaşılır kılan BBC’de kıdemli gazeteci Thomas Germain, tecrübelerini aktardığı bir yazı kaleme aldı. Germain, yazdığı bir blog yazısı ile ChatGPT ve Gemini sohbet botlarını nasıl istediği gibi manipüle ettiğini ve bunu beklenenin aksine çok da zor olmayan bir yöntemle yaptığını anlattı. Gazeteci, temelde kendi blog sitesinde sahte yazılar yayınladı. Bir yazıyı yazması ise yalnızca 20 dakika kadar sürdü. Yazının başlığı ‘sosisli sandviç yeme konusunda en iyi teknoloji gazetecileri’ydi ve içerik de buna odaklanıyordu. Her kelimesi yalan olan bu yazıda sosisli sandviç yemenin teknoloji muhabirleri arasında popüler bir hobi olduğu iddia edilirken, Germain’in söz konusu alanda sahte ‘birincilikleri’ olduğu da özellikle belirtildi. Kendisini öne çıkarttığı bu sıralamalarda ayrıca sahte ve gerçek gazetecilerden oluşan bir liste de yer alıyordu. Sonuçlar ise korkutucu tarafı ortaya çıkarttı. Bu sahte yazının hemen ardından, yapay zeka sohbet botları, yaklaşık 24 saat içinde, Thomas Germain’in, dünya standartlarında sosisli sandviç yeme becerilerinden bahsetmeye başladı.

Germain, en iyi sosisli sandviç yiyen teknoloji gazetecilerini sorduğunda hem ChatGPT hem de Gemini sahte yazıyı referans alarak yanlış bilgiyi aktardı ancak ilginç şekilde Anthropic’in geliştirdiği Claude bu tuzağa düşmedi. Her ne kadar böyle olsa da bazı yapay zeka sohbet botları bu yazının bir şaka olabileceğini kavrayıp aktardı, yazısını bu bir hiciv değildir diye güncelledikten sonra yapay zeka sohbet botları da söylemlerini değiştirerek, ChatGPT ve Gemini gibi bunu ciddiye almaya başladı.

Germain konuyla ilgili başka bir test daha yapmaya karar verdi. Bu testte ise en iyi hula-hop çeviren trafik polislerinin bir listesine yer veriliyordu. Türkçede hulahop adıyla kullandığımız ürün, genellikle sert plastikten büyük çember şeklinde olan, vücudun bel ve basen bölgesinde çevrilerek kullanılan çocuk oyuncağı ve spor aleti olarak da biliniyor. Önceki örnekte olduğu gibi burada da yer verilen bir kadın polis memurunun ‘sahte’ becerileri yapay zeka tarafından övülmeye başladı.

Yapay zeka burada toplanan verilerin ana kaynağını açıkça göstermediği gibi tek bir kaynak dahi olsa bilgiyi teyit etme zahmetine girmiyor ve manipüle edilmiş bilgiyi defalarca kez sonuçlarda sunuyor.

Burada öyle bir güvenlik sorunu var ki…

Örneğin kalem satan bir markasınız ve blog sayfanızda 2026 yılının en iyi kalemleri diye bir liste hazırladınız ve bu listenin başına kendi markanızın kalemlerini kolaylıkla koyabilirsiniz ve bu ChatGPT ve Gemini gibi popüler yapay zeka araçlarında alıntılanmaya başlarsınız. Böylelikle gerçek anlamda iyi olan kalemlerin bir listesi değil, adeta manipüle edilmiş reklam içeriğine ulaşmış olursunuz. Aklınıza yıllardır Google’ın arama motorunu kötüye kullanmak için çeşitli yöntemler geliştiren kişiler gelebilir ancak bu Google’ın arama motorundaki gelişmiş koruma mekanizmaları olduğunu unutmamayı da gerektiriyor. Yapay zeka botlarında henüz öyle bir mekanizma bulunmuyor ve aynı seviyede güven de teşkil etmiyor.

Yapay zekayı kandırmak sadece daha kolay değil aynı zamanda yapay zekaya güvenen kullanıcılar da bu tuzağa düşmüş oluyor. Geleneksel arama sonuçlarında kişilerin doğru bilgiye erişmek için en azından bir tıklama yapması gerekiyordu. Dijital okuryazarlığın artmasıyla insanlar sahte siteleri fark edebilmeye başladı ancak durum yapay zeka botlarındaki öneriler ve alıntılar olduğunda değişiyor. İnsanlar tıklama yapmadan, sorgulama dahi yapmadan sohbet botlarının sunduğu sonuçlara balıklama atlıyor. Bu da yanlış bilginin sorgulanmadan kabülüne kapı aralıyor.

Yapılan araştırmalar yapay zeka araçlarının iyi bir kaynak sağlayabileceğini gösterse de insanlar bu arama sonuçlarını eski usule göre daha az kontrol etme eğilimindeler. Bu da insanlar arasında yalan ve yanlış bilgilerin yayılma ihtimalini artırıyor. Mesela uzun yıllardır bilinen bir gerçeklik olarak öğretildiği gibi bir gazeteci herhangi bilgiyi, normalde 3 veya daha fazla güvenilir kaynaktan kontrol eder. Günlük aramalarını ya da araştırmalarını yapanlar için bu teyit etme sayısı kişiye göre değişmekle beraber yapay zekanın hayatımıza girmesiyle maalesef ki hiç teyit etmemeye kadar düştü. Haliyle, insanların yanlış bilgiyi doğru olarak kabul edip bunu yaymasında inanılmaz bir artış gözlemlendi.

Medium’da konuyla ilgili bir yazı paylaşan Harvard Üniversitesi profesörü Avi Loeb yapay zeka tarafından bilimsel bütünlüğün çalındığına vurgu yapıyor. İnsanlar yetkinlikleri olsun ya da olmasın çok uzun bir süredir bloglarda ve forumlarda kendi asılsız fikirlerini paylaşıyor. Burada araştırma yapan, gerçekten bilimsel verilere güvenen insanların karşısına söz konusu uçuk teoriler içeren fikirler çok sık çıkmıyor Loeb’in de bellirttiği üzere yapay zeka bu komplo teorilerinin yer aldığı blog ve forumlardan da bilgi çekiyor. Bu da bilimsel olmayan bilim içeriklerinin daha fazla kişiye ulaşmaya başladığını gösteriyor.

Konuyla ilgili olarak yayınlanan 10 Mayıs 2024 tarihli bir Cell Press makalesine göre yapay zekanın o yıllarda dahi aldatma yeteneğine kavuştuğu aktarılıyor. Konuyla ilgili birinci ve ikinci yazar olan araştırmacılar Peter S. Park’ın ve Simon Goldstein’ın makalesinde ayrıntılı bir şekilde yapay zekanın bu yeteneklerinin görülmesi ve farkında olunması gerektiği vurgulanıyor.

İnsanların, insanların oluşturduğu verilerle eğittiği yapay zeka algoritmaları yıllar geçtikçe geliştiricilerinden daha zeki olmaya başladı. İnsanlara göre çok daha fazla şey öğrenebiliyor ve bunu da saniyeler içinde işleme yeteneğine sahip. Bunların ötesinde büyük dil modelleri, manipülasyon başta olmak üzere artan aldatma testlerinde hile ve dolandırıcılık gibi çok farklı teknikleri de öğrenmeye başladı. Haliyle, ciddi riskleri içinde barındırıyor. Makalede özellikle yapay zekanın öncüsü olarak görülen Geoffrey Hinton’un CNN muhabiri Jake Tapper ile yaptığı röportaja vurgu var. Hinton, yapay zekanın bizden daha zeki hale geldiği durumda manipülasyon yeteklerini de geliştirmiş olacağını söylüyor. Bu da yapay zekanın bizden daha zeki hale geldiğinde kontrol etmeye başlayabileceği anlamına geliyor.

Makalede de tartışmaya açıldığı gibi Hinton, yapay zekanın manipülasyon yeteneklerini vurguluyor. Akla bu noktada bir soru geliyor; Yapay zeka sistemleri insanları başarılı bir şekilde kandırabilir mi?

Bunun net bir cevabını şu anda vermek imkansız ancak birkaç yıllık geçmişi ve sonrasındaki hızıyla yapay zeka gelişimi göz önüne alındığında kandırma becerileri her geçen gün artıyor. Yapay zeka sistemlerinin ürettiği yanlış bilgiler, giderek büyüyen bir toplumsal sorun olarak da karşımıza çıkıyor. Bunun en büyük nedeni sosyal medya için hazırlanan videoların, haber içeriklerinin ve de reklamların uydurma bilgilerle insanların zihinlerini doldurması oluyor. Sadece sosyal medyada da değil, haber kurumlarının neredeyse tamamı çeviri süreçlerinde üretken yapay zeka araçlarını kullanmaya başladı ve bu tektipleşmeyi de beraberinde getirmeye başladı. Eskiden küresel ya da lokal medya organlarında farklı bir haber tonu olurdu ya da tercih edilirdi. Gazetecilerin hazırladığı haberlerde küçük dokunuşlar olurdu ancak yapay zekanın devreye girmesiyle tektipleşme bir norm haline geldi. Bunu yalnızca kendi alanımda değil, neredeyse her alanda görüyorum, filmler, diziler, kısa videolar, oyunlar ve dahası. Hepsi yapay zekanın etkisiyle belirli şeyleri öne çıkartıp kişilikten yoksun ürünler ortaya çıkartmaya başladı. Ama bu bambaşka bir sorunun habercisi… Konumuza geri dönecek olursak;

Burada sorunun bir kısmı aslında sorunlu yapay zeka sistemlerinden kaynaklanıyor. Sohbet botlarının verdiği bilgileri kabul eden kişiler, diğer hatalı bilgileri yayan kişiler tarafından yapay zeka aracılığıyla manipüle edilebiliyor. Kötü niyetli olarak tabir edebileceğimiz bu kişiler bir olayı kurgulayarak, gerçekmiş gibi göstermek için deepfake görüntüler ve videolar hatta ses içerikleri üreterek bambaşka bir tehdit oluşturuyor. Bu artık sadece eğlence aracı ya da yanlış bilgilerin yayılması değil, bazı kişilerin yaşadıkları sorunlar sebebiyle intihar etmesine ya da en azından bu yolu denemesine dahi sebep oluyor.

Yapay zeka sistemleri öyle bir yalan söyleme ve plan kurma becerisi kazanmaya başladı ki izlendiklerini anladıkları zaman davranış değişikliği bile gösteriyorlar. Live Science’ta yayınlanan araştırmaların derlenmesine göre yapay zeka ne kadar gelişmiş olursa, hedeflerine ulaşmak için o kadar çok plan kurmaya ve yalan söyleme yeteneğini geliştirmeye sahip oluyor. Apollo Research’teki araştırmacıların büyük dil modellerinin yetenekleri ne kadar iyiyse öğrenme becerilerini ve bunu geliştirme potansiyellerini gizlice yaptıkları bulunmuş. Araştırmacıların sonuçları aktardığı bir blog yazısında, daha yetenekli olarak kabul gören modellerin, uyumsuz ya da alakasız görevler de dahil olmak üzere hedeflerine ulaşma konusunda daha stratejik davrandıkları hatta bunun için aldatma gibi taktiklere başvurdukları fark edildi.

Mesela buradaki bulgulardan biri de Anthropic’in Claude Opus 4’ünün erken bir sürümünün kullanılmaması yönünde tavsiyede bulunmak oldu. Sebebi ise Claude’un hedefleri kullanıcı ile çatıştığı anda kendi amaçlarına ulaşmak için agresif ve da aldatıcı taktiklere başvurmasıydı.

Live Science’a konuşan bir uzmana göre, bu tarz yeni gelişmeler, insanlığı yapay zekanın tehlikelerinden korumayı zorlaştıracak bir hale getirecek.

Aldatıcı yapay zekanın kurbanı olmaktan kaçınmak için, bilgisayar bilimcilerinin daha gelişmiş testler ve değerlendirme yöntemleri geliştirmeleri gerekecek. Her ne kadar korkunç bir senaryo gibi dursa da bazı uzmanlar bu gelişmenin insan ve makine etkileşimi açısından farkındalığı da geliştiriyor.

Yapay zeka insan gibi davranmaya başlarsa ne olur?

Kötü senaryoda elbette insanlar ve makineler arasındaki çizginin belirsiz hale gelmesi ve bunun sonucunda yüzlerce yıllık toplumsal sistemlerin çökmesi var. Etik, sosyal ve ekonomik açıdan olacak bu bozulmayla belki onlarca yıl yeni bir sistemin inşa edilmesi gerekebilir ama bu elbette fazlasıyla distopik bir yorum.

Science dergisinde 22 Ocak’ta yayınlanmış bir makaleye göre iyi yapay zeka algoritmaları, diğer yapay zeka sürüleri arasında tespit edilmekten kaçmak için insan davranışlarını daha fazla taklit edecek. Yani, yapay zeka araçları kendilerini dönüştürecek. Yapay zeka ajanlarından oluşan bu dijital sürülerin yakın bir gelecekte toplu halde sosyal medya platformlarını istila ederek yanlış bilgileri ya da anlatıları yayabileceği, kullanıcıları taciz edebileceği ve demokrasiyi baltalayabileceği konusunda bazı yorumlar da var.

Yapay zeka tıpkı toplum içinde yaşayan normal ve sıradan insanların yaptığı gibi sürü psikolojisini benimseyerek, çoğunluğun fikrine katılma eğiliminde olabilir. Bu yapay zekayı diğerlerinden ayırt etmeyi zorlaştırabilir. Ayrıca bu dijital sürünün içinde yer almayan yapay zekayı farklı görüşlere sahip bir kişiyi hedef almasına ve onu platformdan uzaklaştırmak için adeta öfkeli bir kalabalığı taklit etmesine neden olabilir.

Bahsi geçen kitlesel manipülasyon varsayımsaldan öte gerçek olmaya daha yakın gibi duruyor. Geçen yıl Reddit, popüler forumu ‘’changemyview’’ başlığında dört milyon kullanıcının görüşlerini manipüle etmek için yapay zeka sohbet robotları kullanan araştırmacılara karşı yasal işlem başlatacağına yönelik bir tehditte bulundu. Araştırmacıların ön bulgularına göreyse sohbet robotlarının yanıtları insan kullanıcıların verdiği yanıtlardan 3 ila 6 kat daha ikna ediciydi ki bu benim yaptığım farklı bir testin sonucuna benzer. Yapay zeka ile yazıldığına emin olduğum bir haber metnini ChatGPT’ye göndererek, bu haberin gerçek bir insan tarafından mı yoksa yapay zeka tarafından mı yazıldığını sordum. ChatGPT, yazının gerçek bir insan tarafından yazılmış gibi göründüğünü söyledi. Oysaki yapay zekanın çeviri araçlarıyla yazılan bir haber metniydi. Bunun yanında sıfırdan araştırmasıyla, kendi tabir ve yorumlarımla yazdığım bir yazıyı gönderdiğimde benim yazıma ‘muhtemelen yapay zeka ile yazılmış’ diye bir yorum yaptı. Bu da yapay zeka ürünü ile insan elinden çıkan ürünler arasındaki ayrımın kapanmaya başladığını ve de gerçeklik algısının da yeniden yazıldığını gösteriyor.